- 项目名称

- Pi - 离线数据任务上报和调度

- 项目背景

-

a.项目初衷是为了给分散世界各地的爬虫数据提供一个统一上报、处理、任务调度的控制模块;

b.期望接耦不同已上报任务的数据处理工作(下载 → 解析 → 入库等),如长时任务和及时任务计算资源的隔离,又或是海量及时任务的多节点并行计算,达到分布式处理效果;

- 功能列表

-

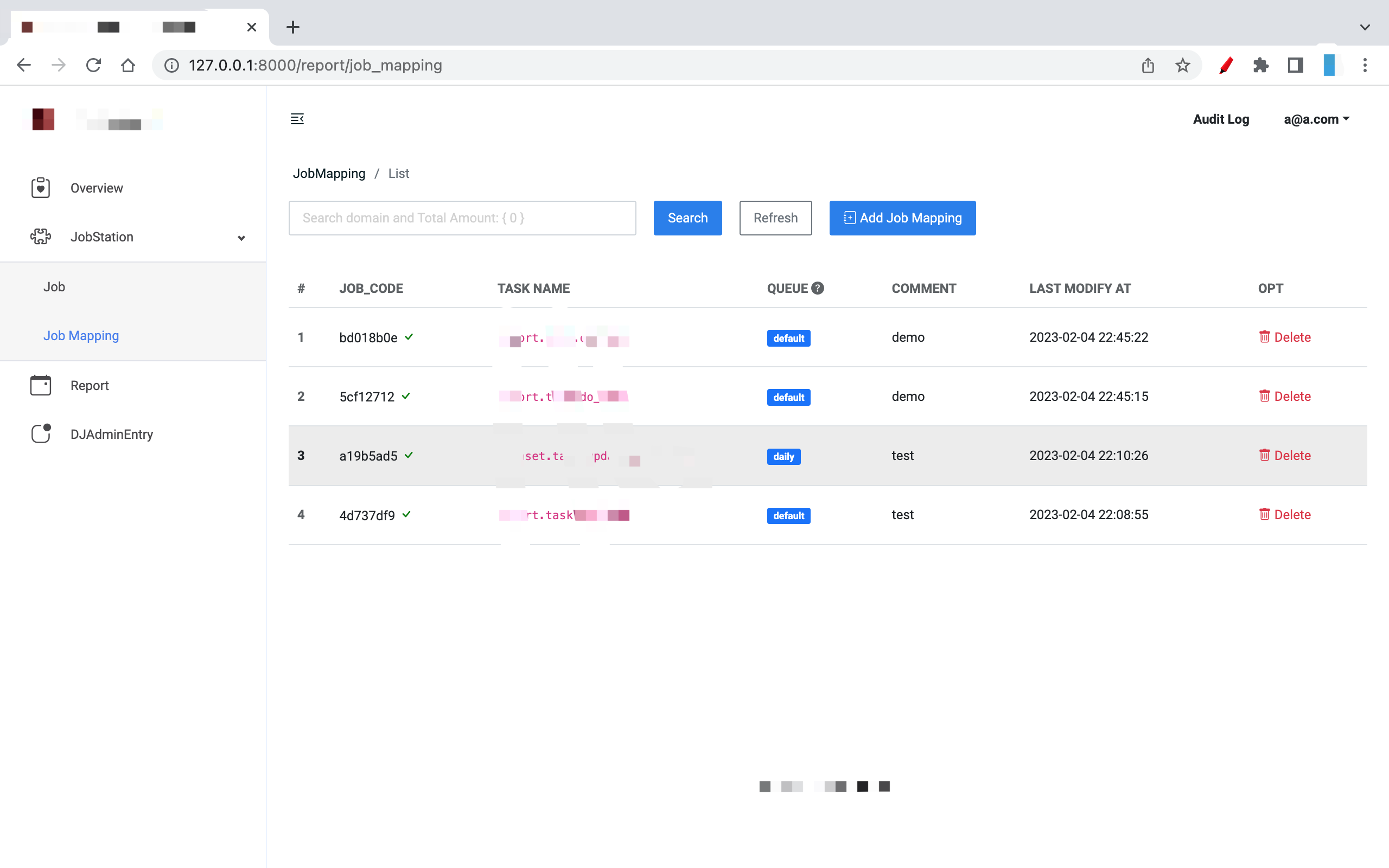

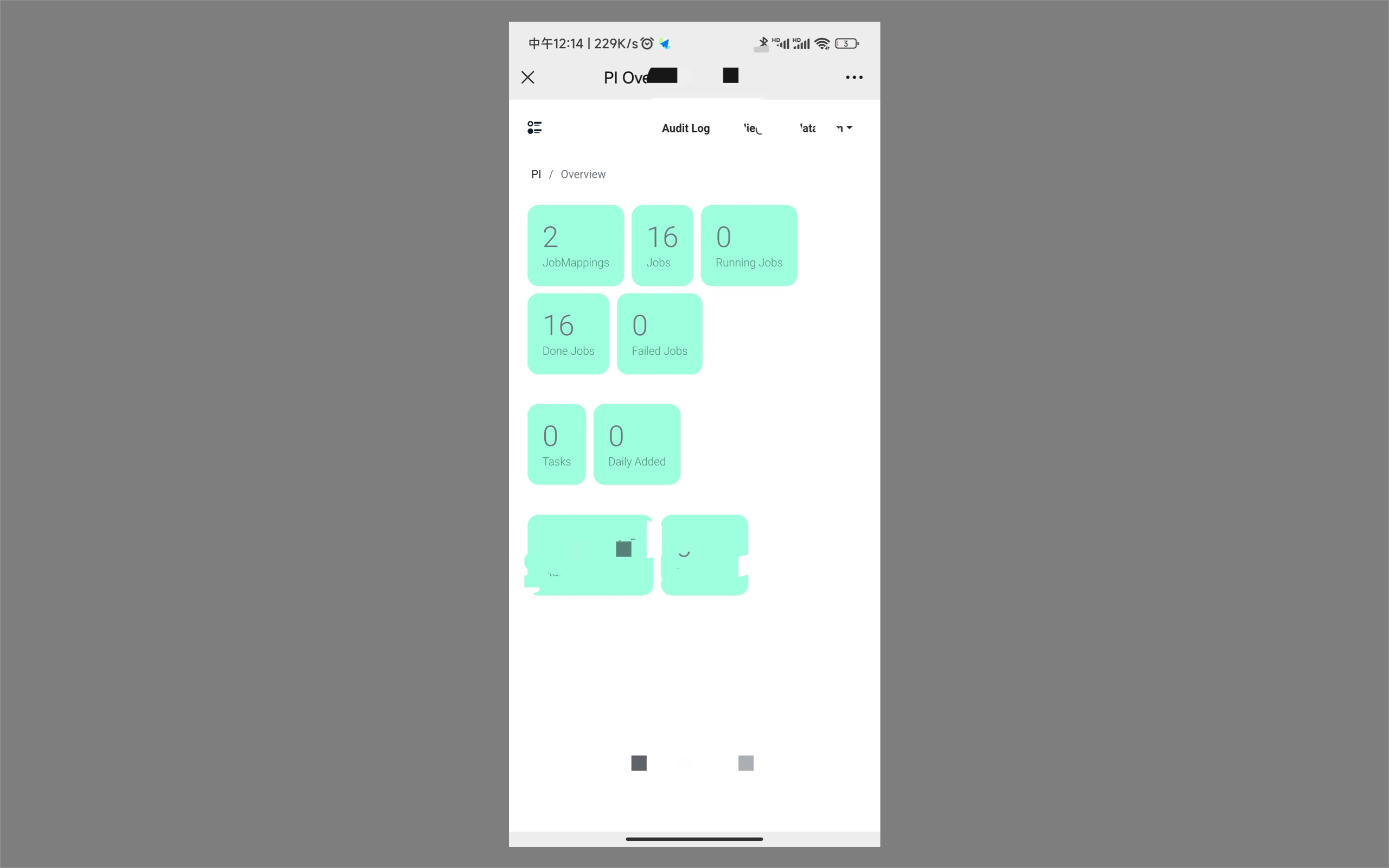

1.可对每个可信上报任务的映射(job mapping)ID进行管理维护;

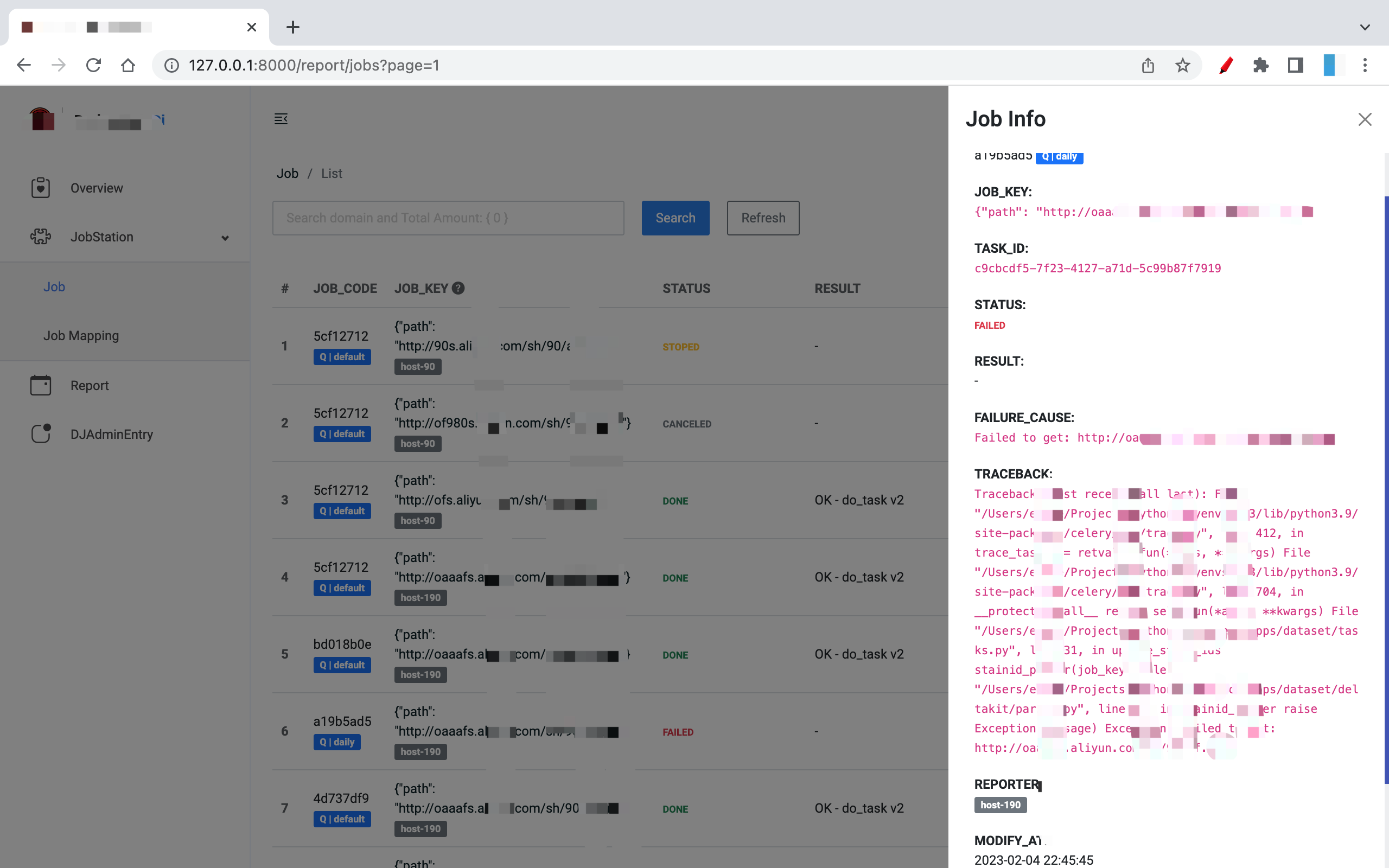

2.可针对每个已接收到的任务(job)状态进行管理;

3.可在不同计算性能或者不同地域的服务节点上,通过部署watch不同队列的worker模块来消费不同耗时的队列的任务,从而达到更好的数据清洗效率;

4.可针对每个上报任务(job)数据处理的异常状况进行追踪,并做告警处理;

- 项目名称

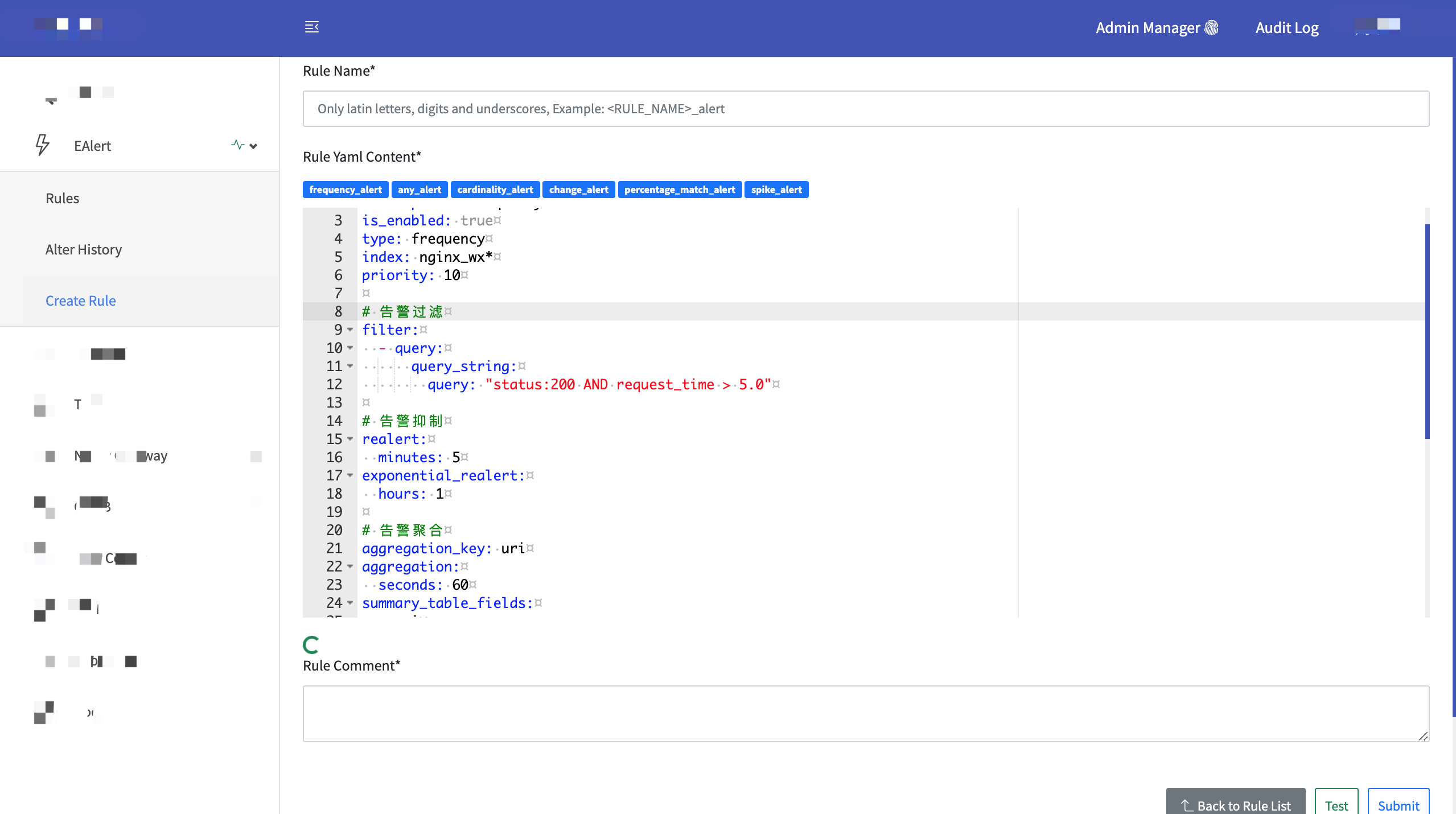

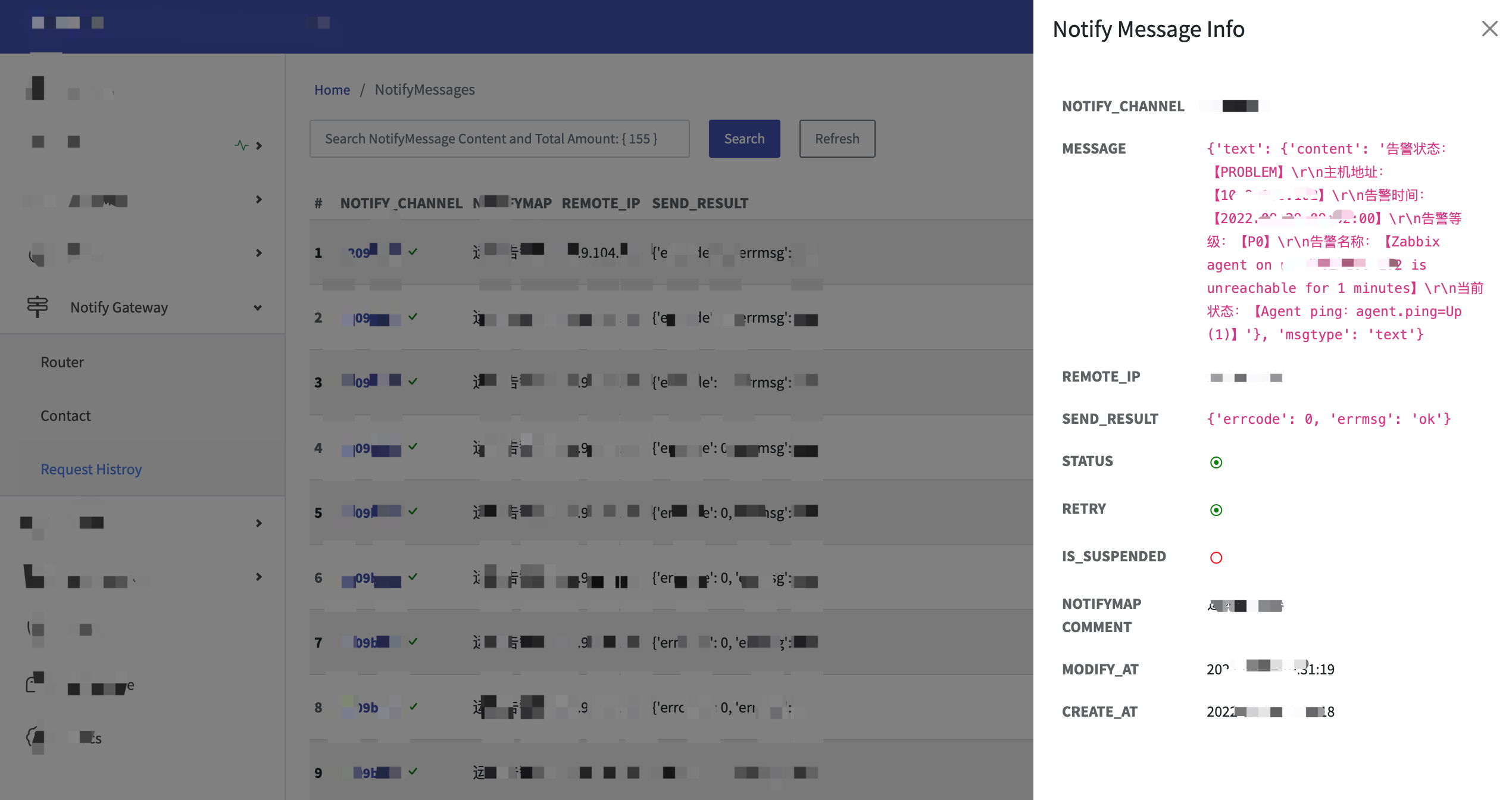

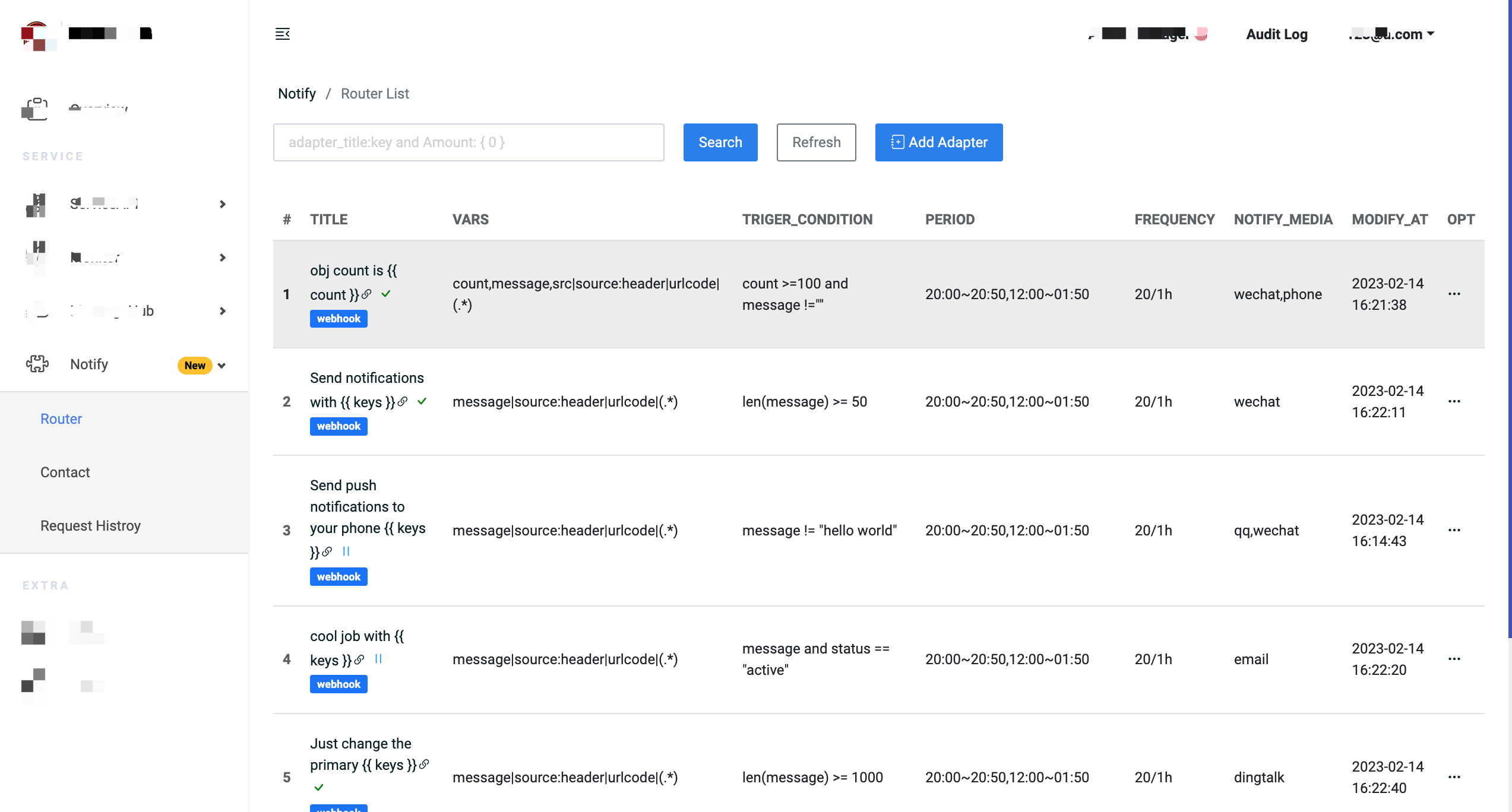

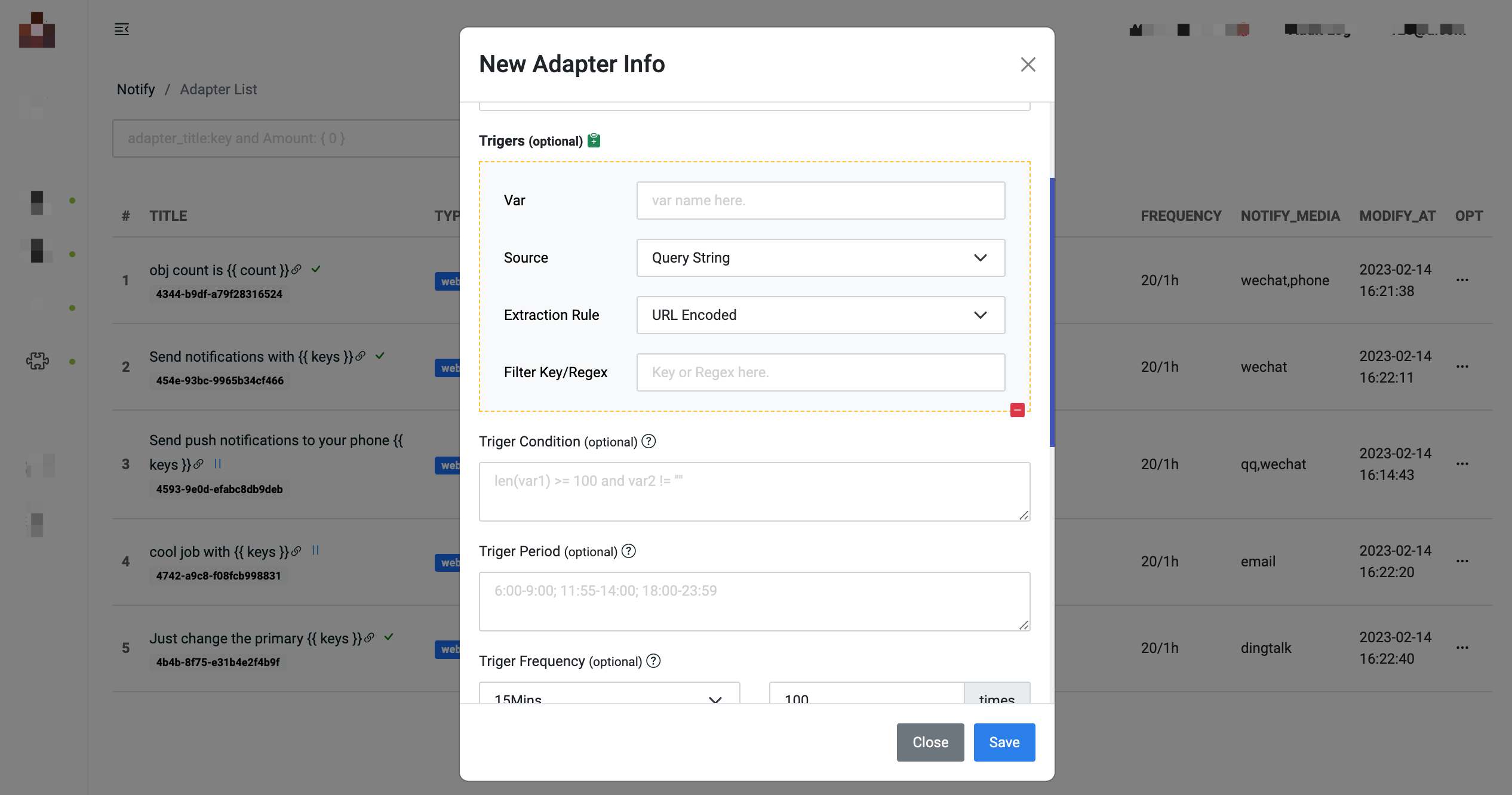

- ElastAlert-ext - 一个基于ElastAlert深度定制化的告警服务

- 项目背景

-

a.海量的业务日志数据需要被过滤、通知或告警;

b.能够与现有的运维平台集成管理;

c. 需要基于数据库的规则存储更加灵活可定制且便于维护;

- 功能列表

-

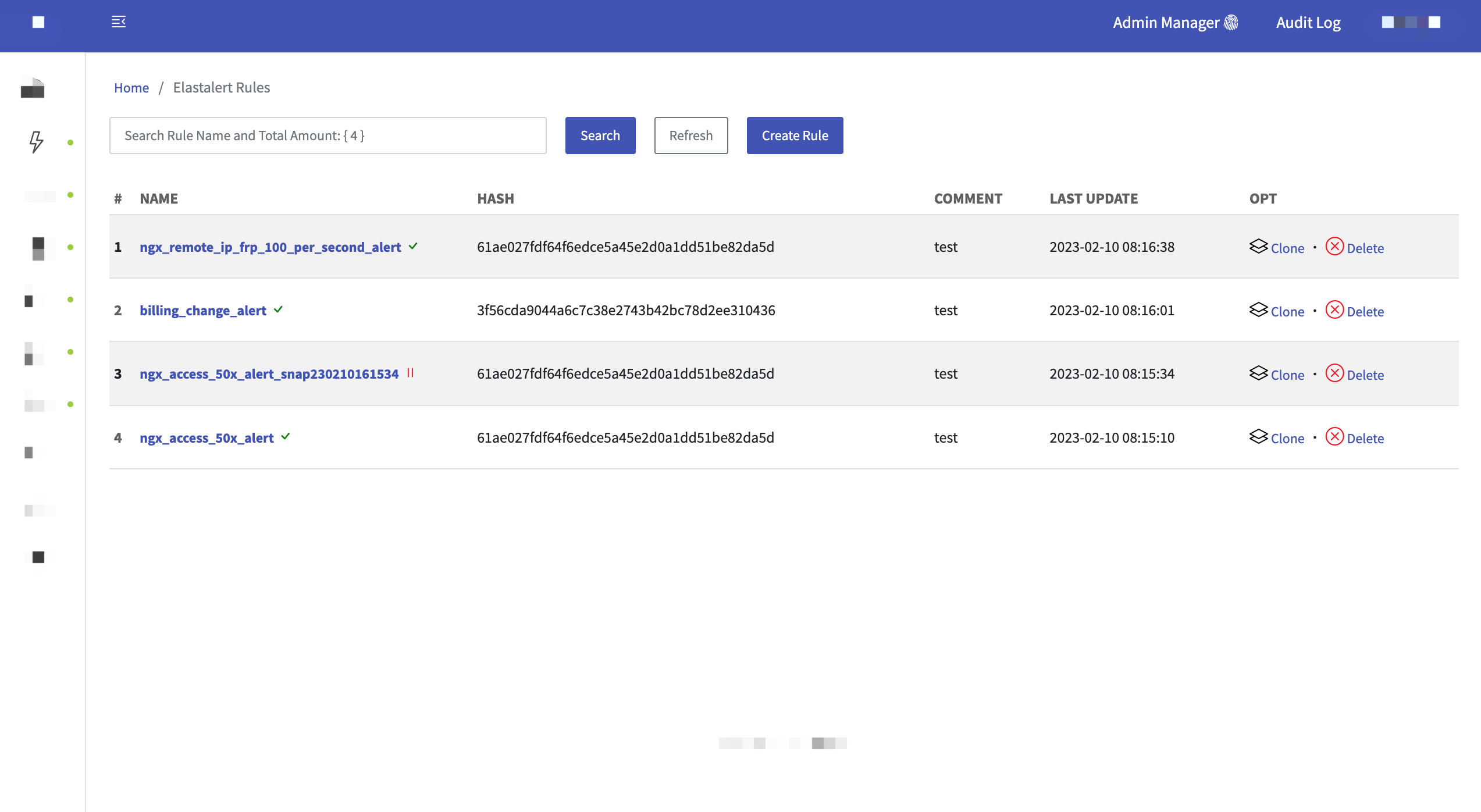

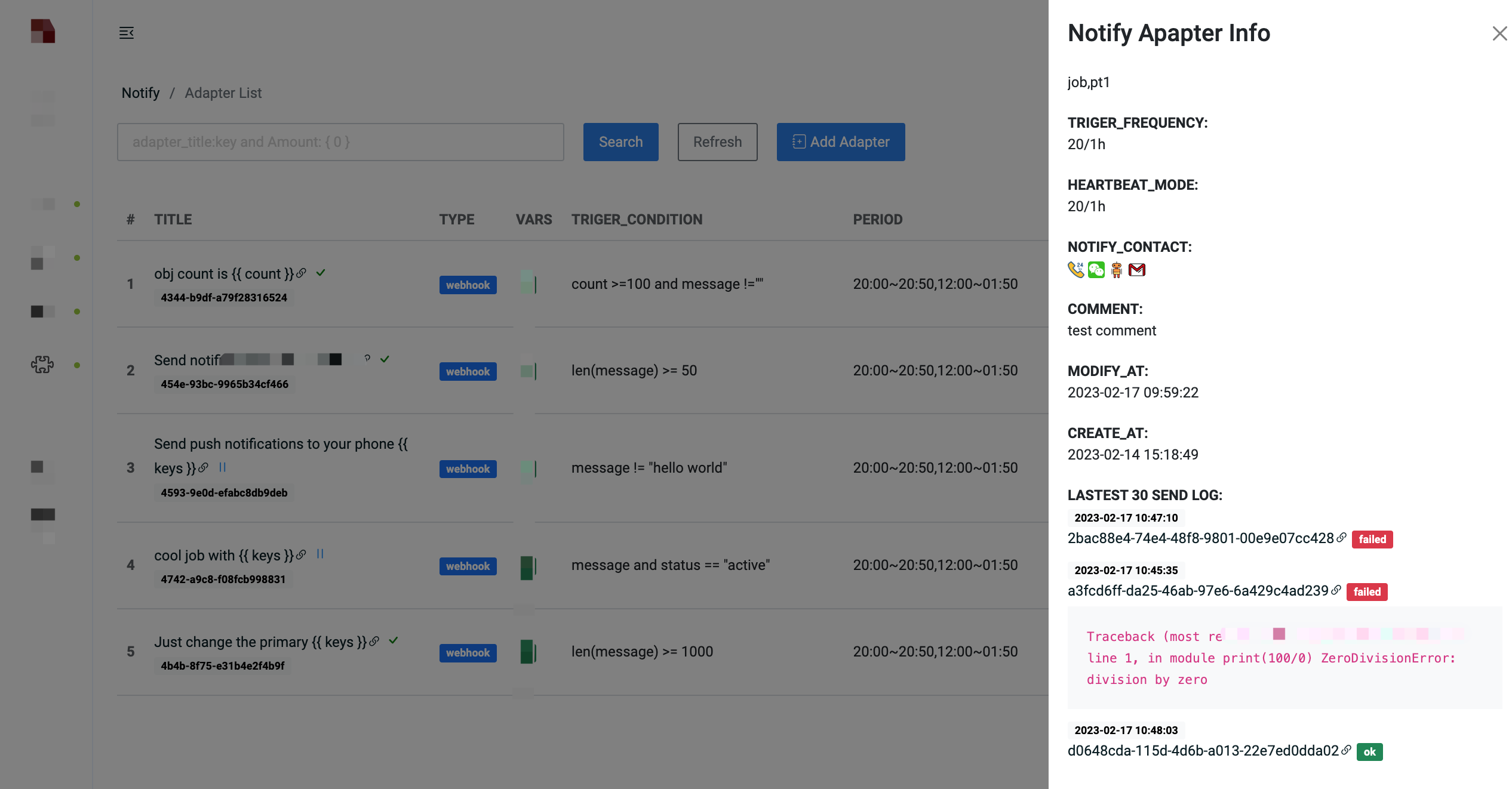

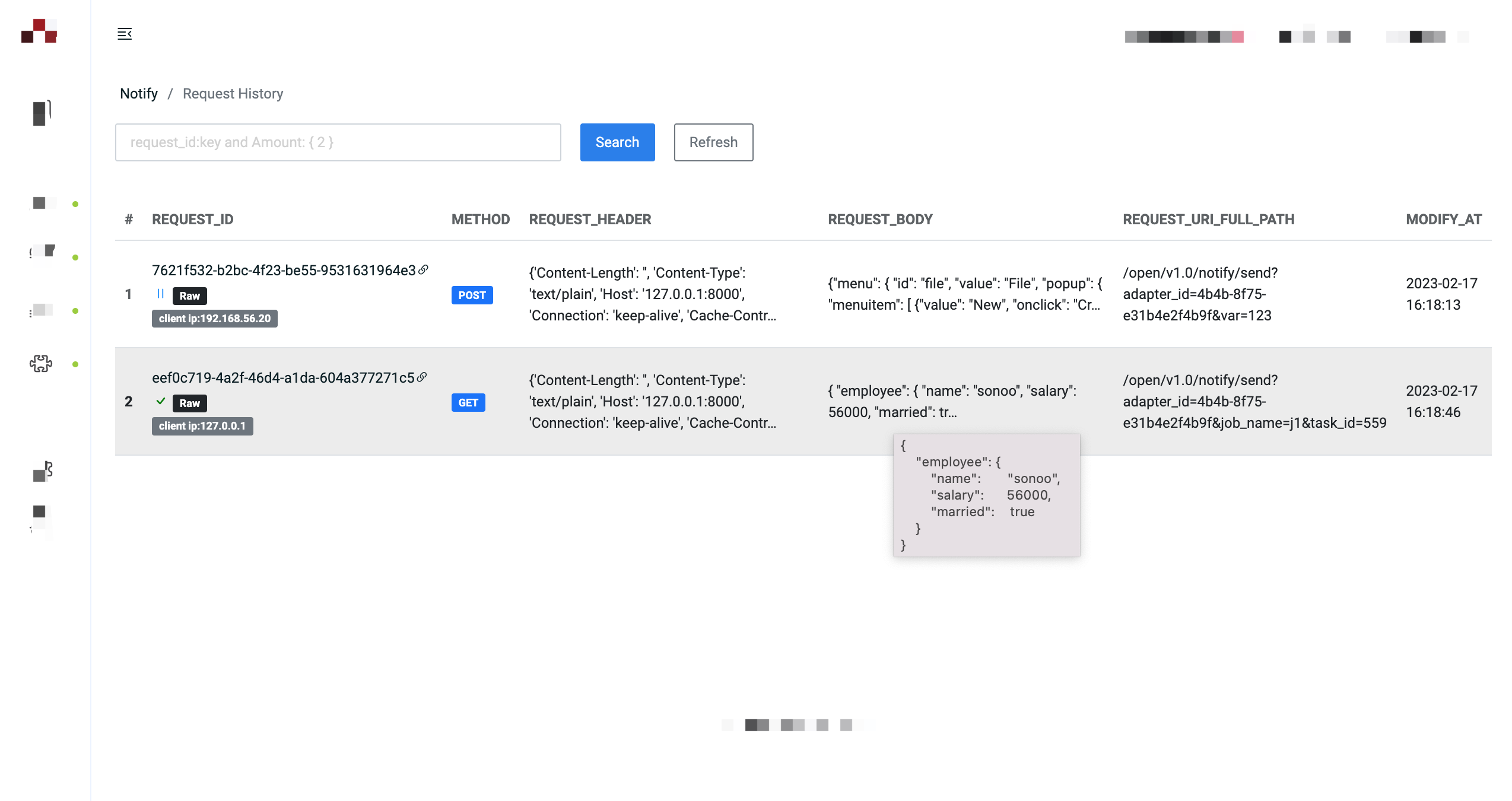

1.可支持通过web端对alert rule的添加/修改/删除等管理工作;

2.可支持alert rule存储于后端任意关系型数据库/mongodb;

3.可支持对不同类型的alert rule模版化引用;

4.可支持对alert rule的语法检测;

5.可支持用户级对alert告警的订阅(需要下面notify模块支持);

6.可支持Promethus监控体系的健康监测;

7.可支持多告警渠道的适配(需要下面notify模块支持);

- 项目名称

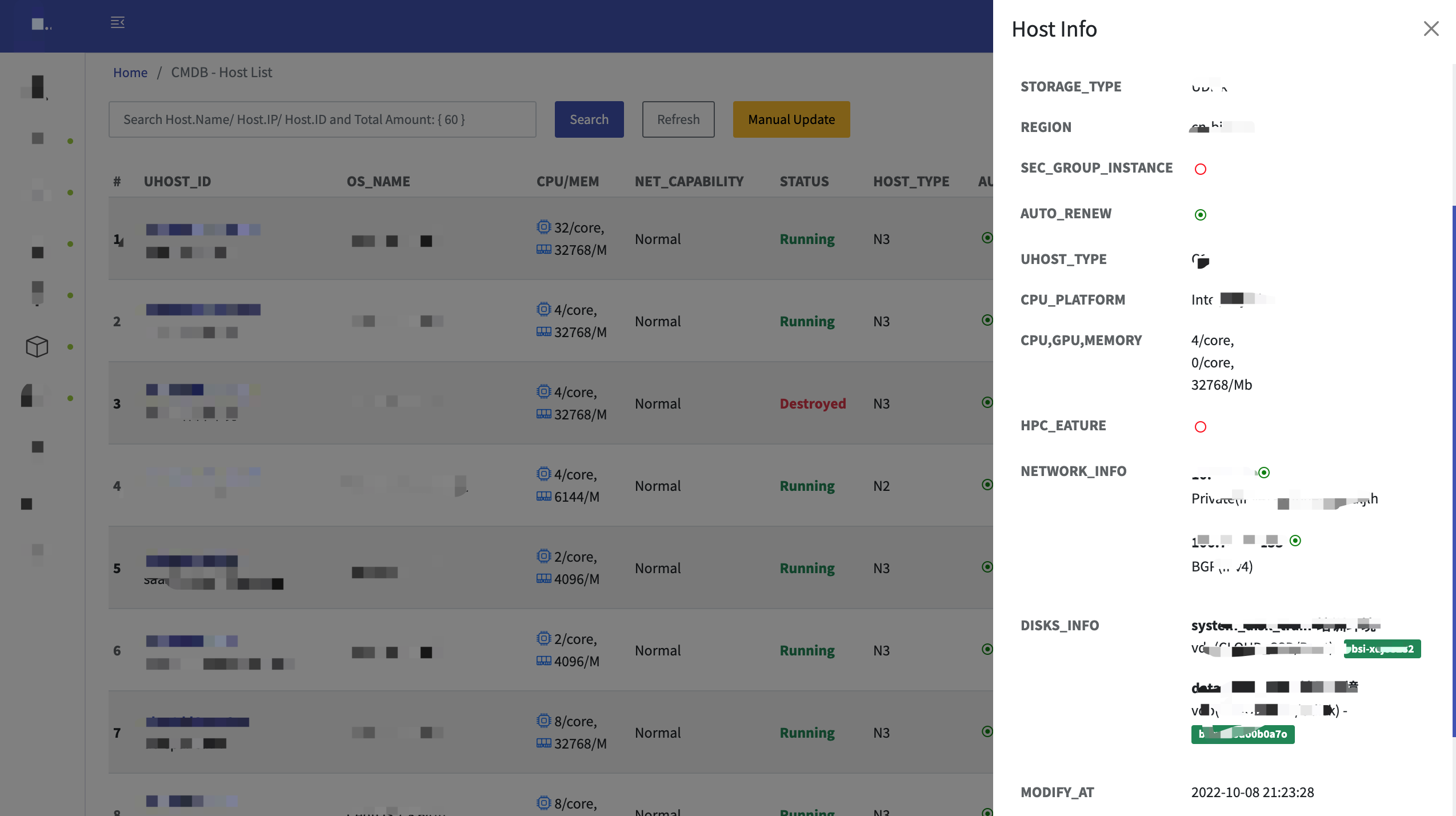

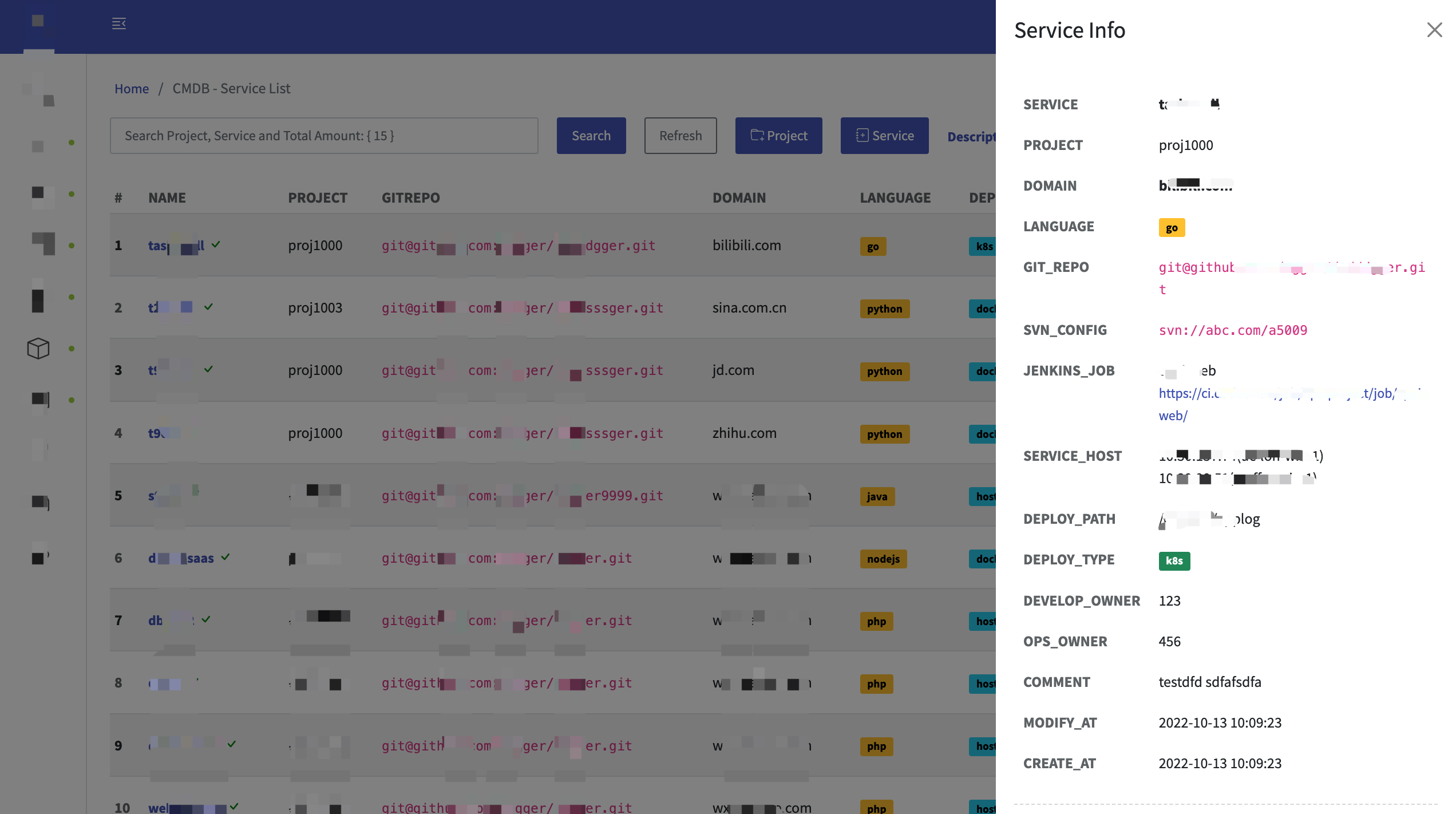

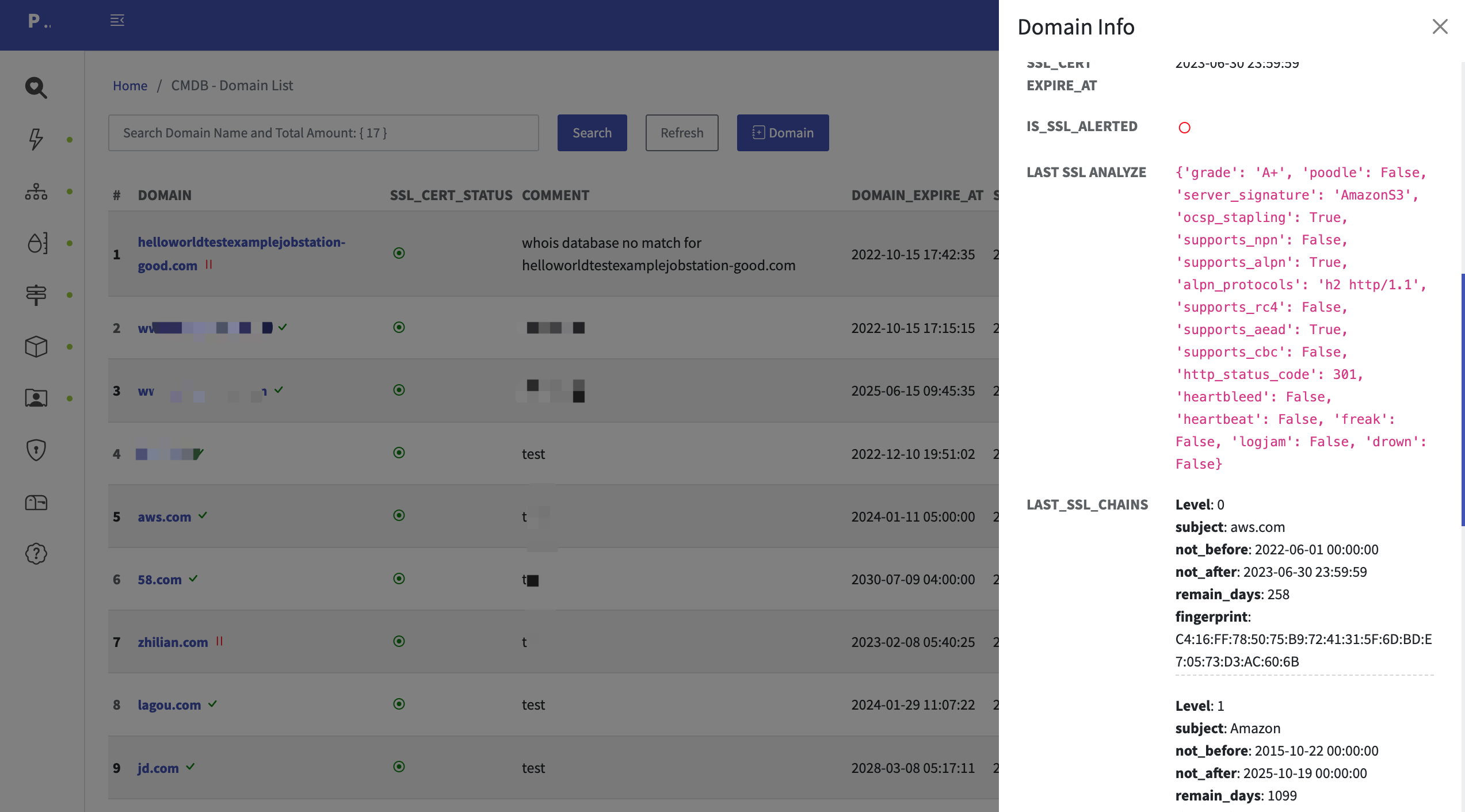

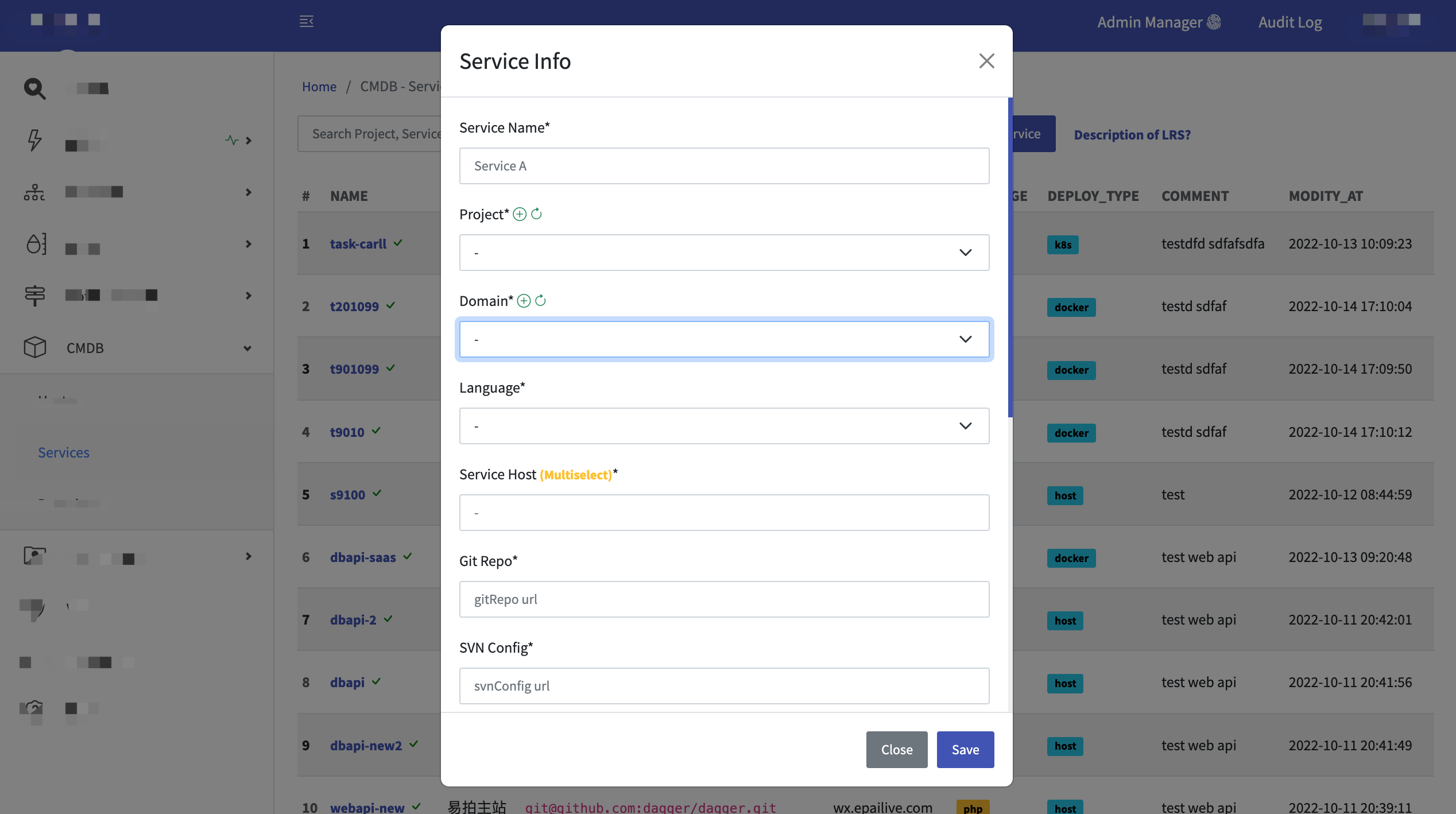

- CMDB - 资源(云物理资产、逻辑关系、认证、API等)管理服务

- 项目背景

-

a.期望对所有IDC资源、公/私有云资源、办公区网络及耗材等集中管理;

b.期望提供基础资源的api接口供其他子平台调用;

c.期望提供用户的统一管理和授权功能,又如能够对一些知名开源第三方平台集成登陆认证和授权;

- 功能列表

-

1.可支持对所用员工信息(用户名、邮箱、手机号、部门、职级等)的统一管理和维护;

2.支持各方资源的定时/被动采集;

3.可支持数据源同步功能,如cmdb → openldap/ cmdb → 第三方平台;

4.现有资源的api查询服务;

5.企业微信APP扫码登录;

6.定期的资源使用情况报表;

7.单点登录服务(可选);

- 项目名称

- FuxiProject - 一个基于原生OpenVPN的管理平台

- 项目背景

-

a.应IT支持部门需求,可以支撑海量openvpn客户端的管理和流控制,以及所有专有网络访问的审计

- 项目组件

-

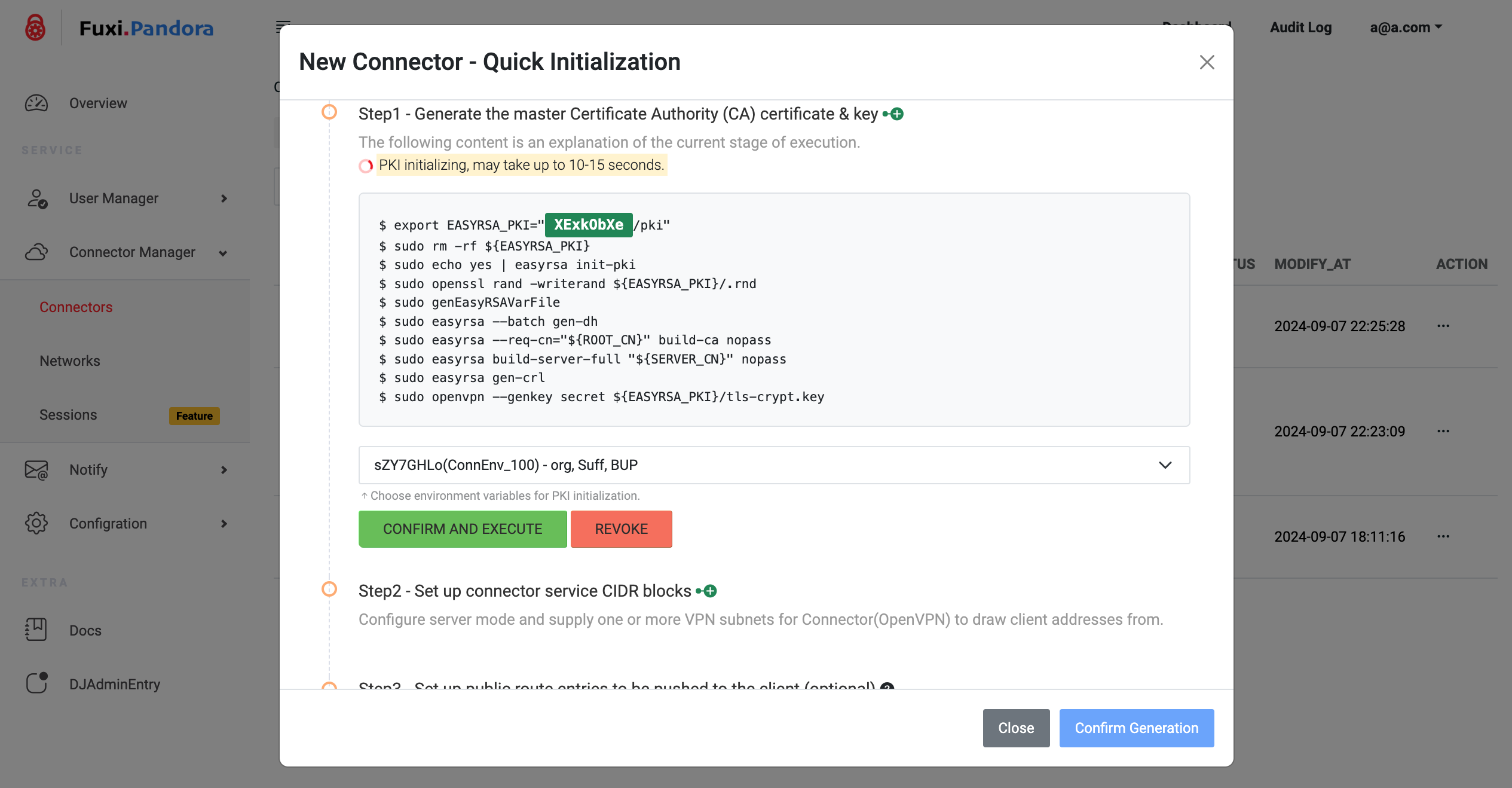

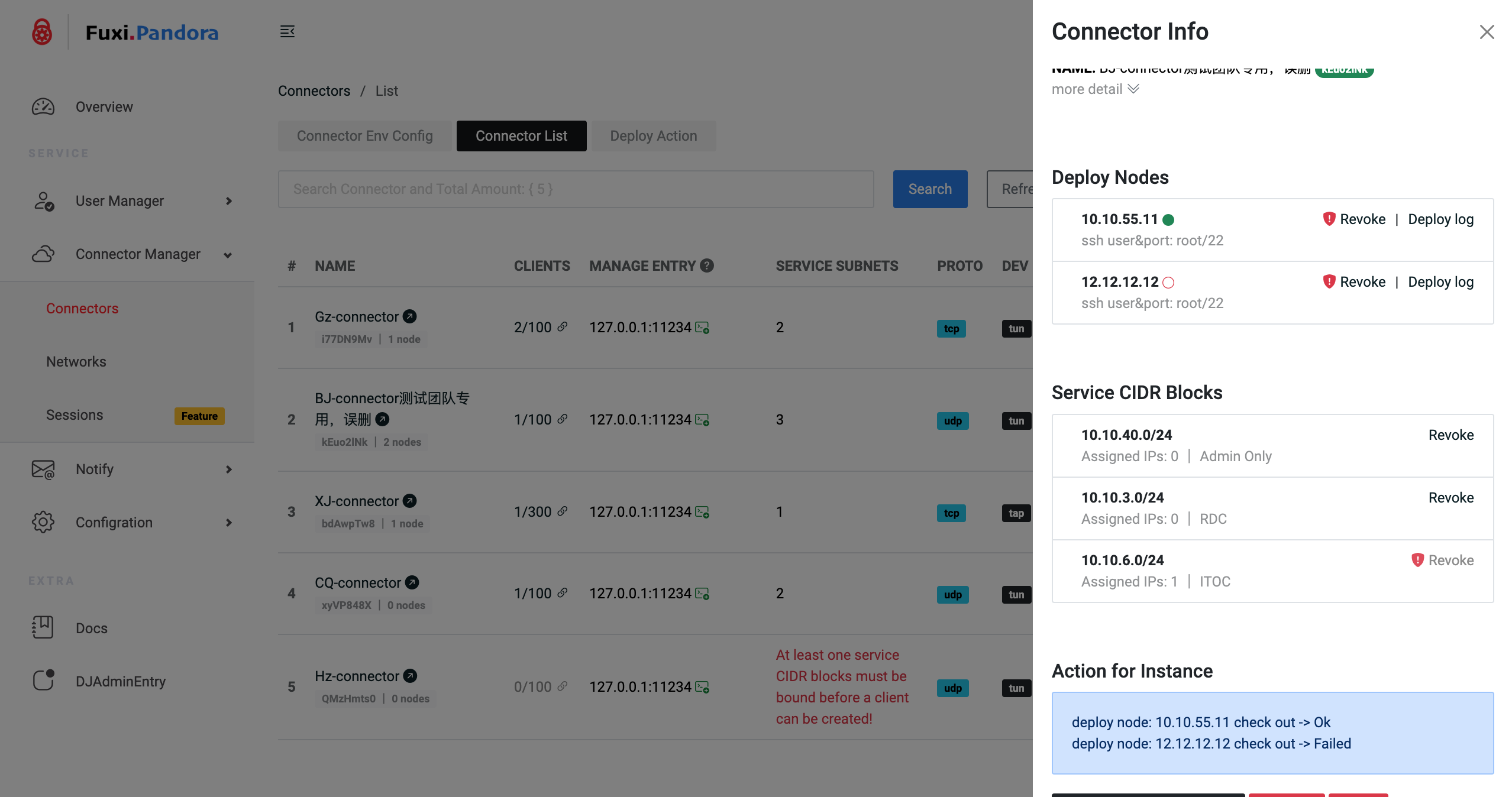

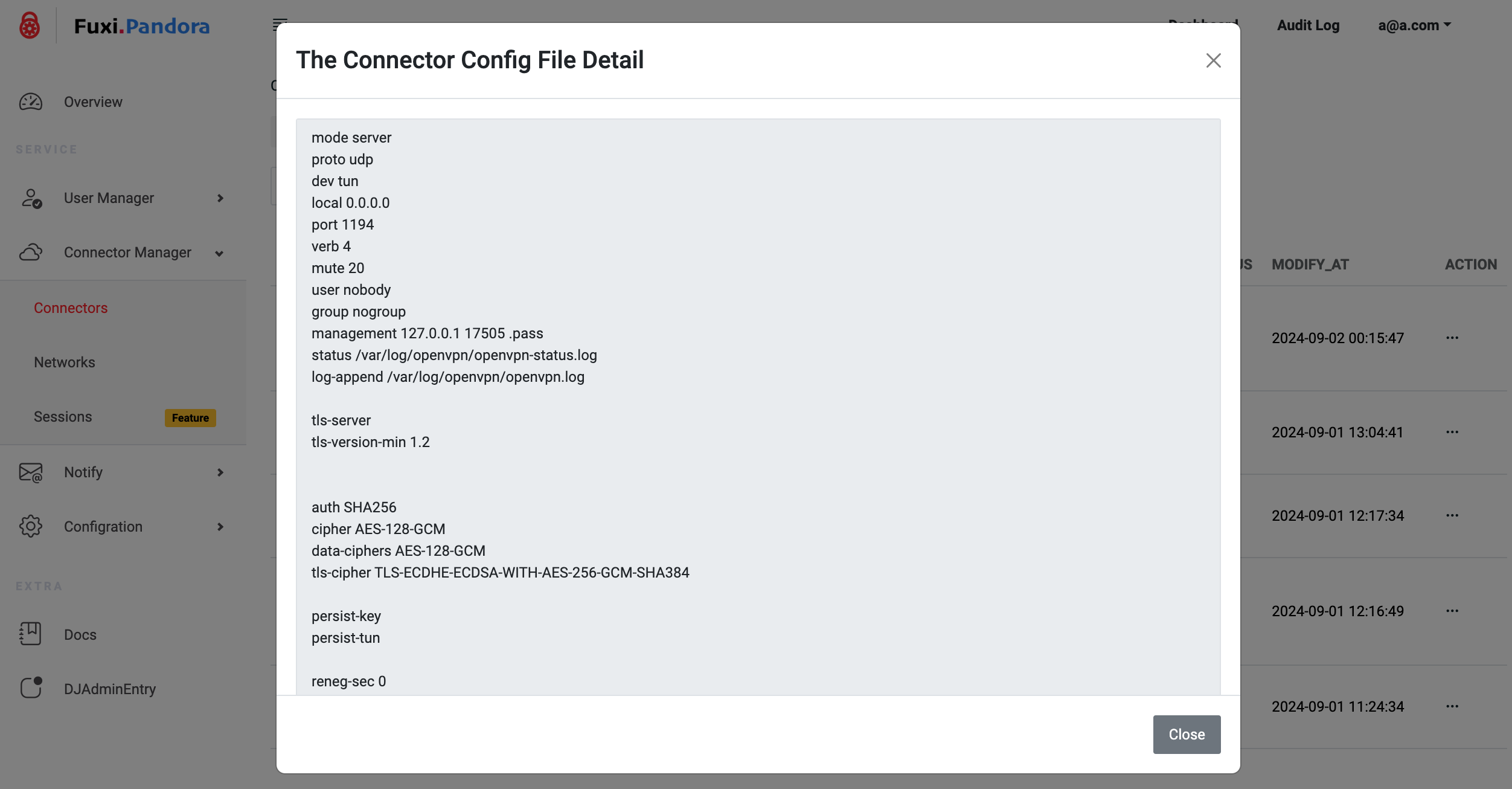

OpenVPN 2.5+, Fuxi-Runner/Kit, Fuxi-Web

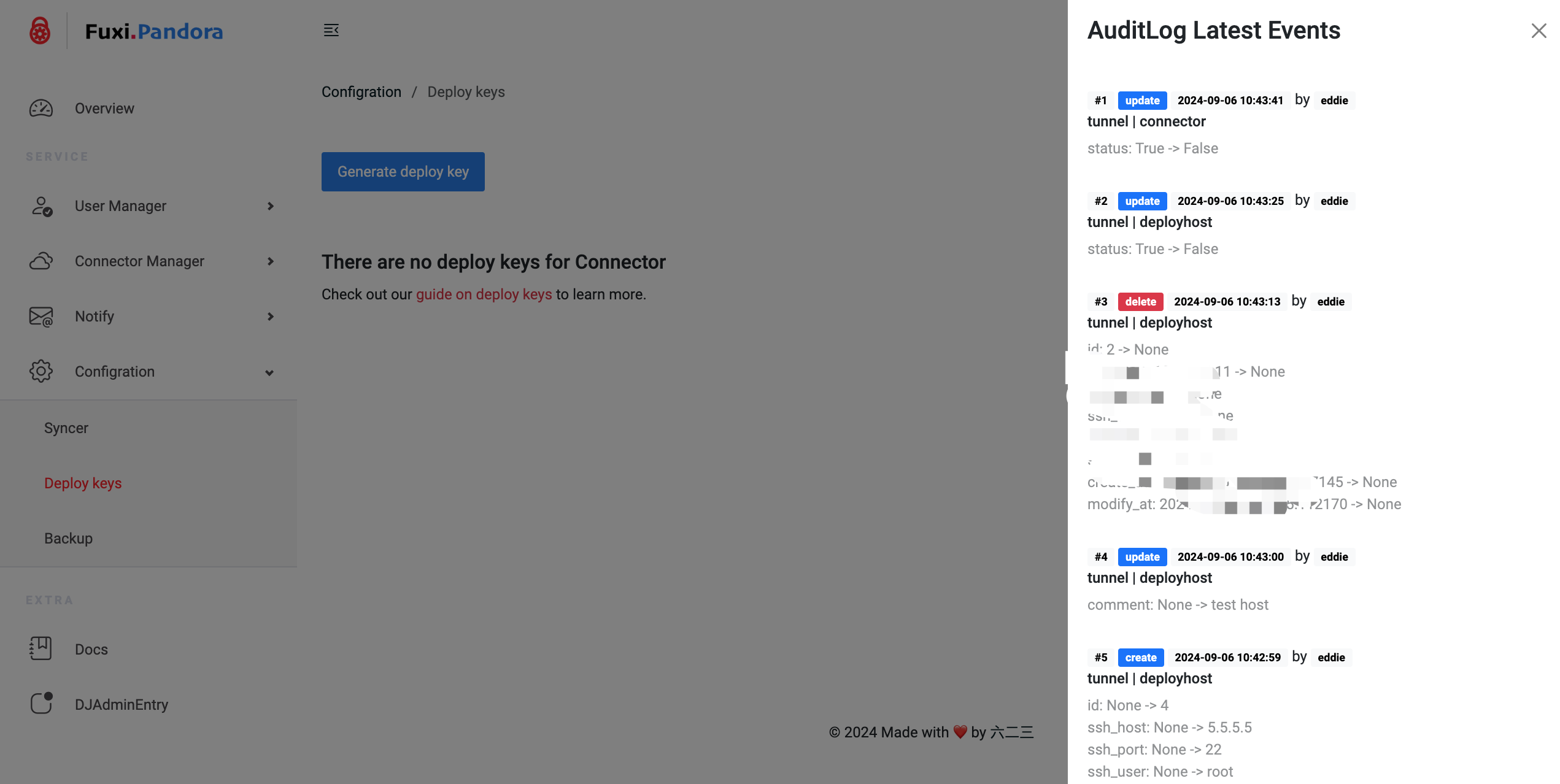

- 功能列表

-

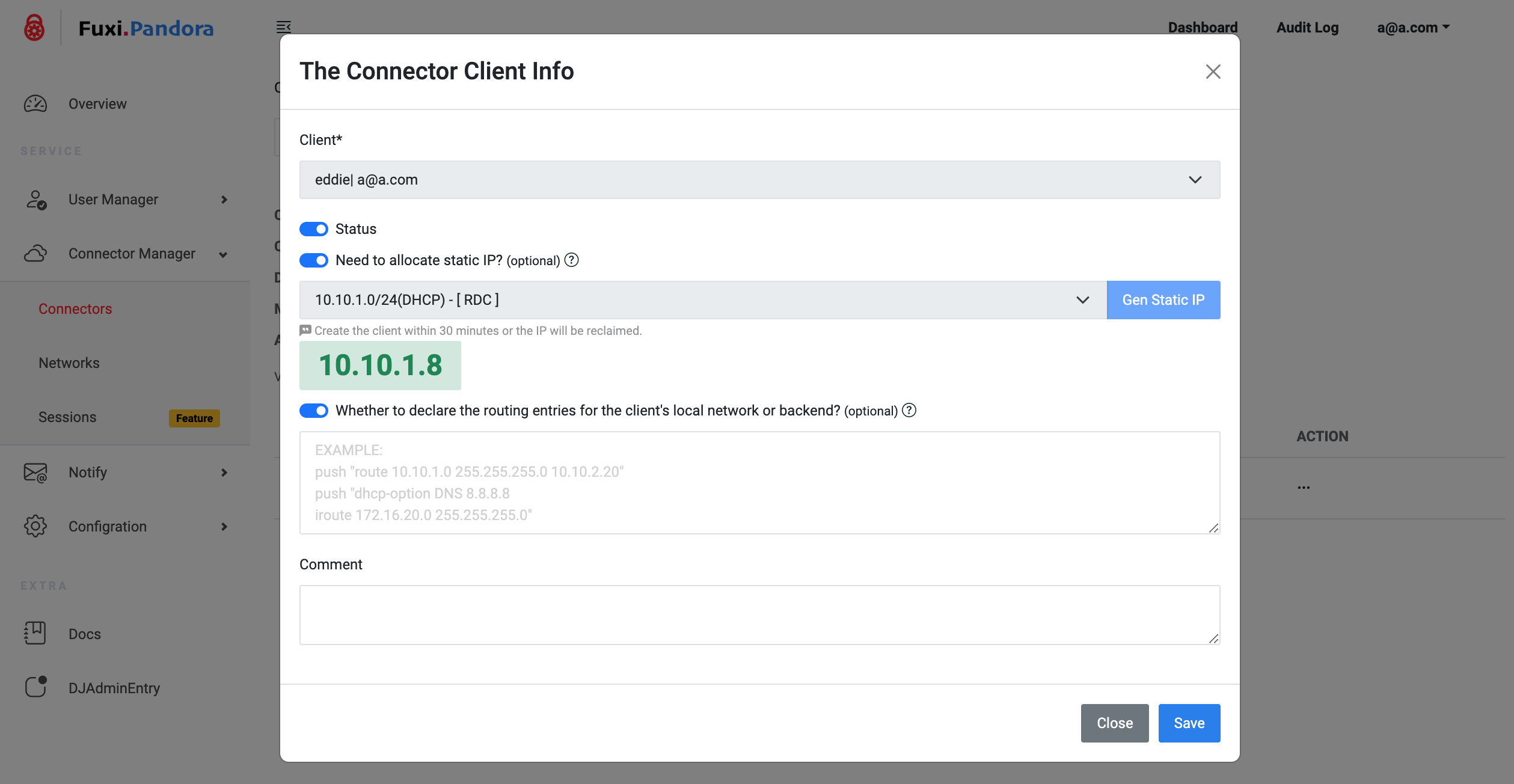

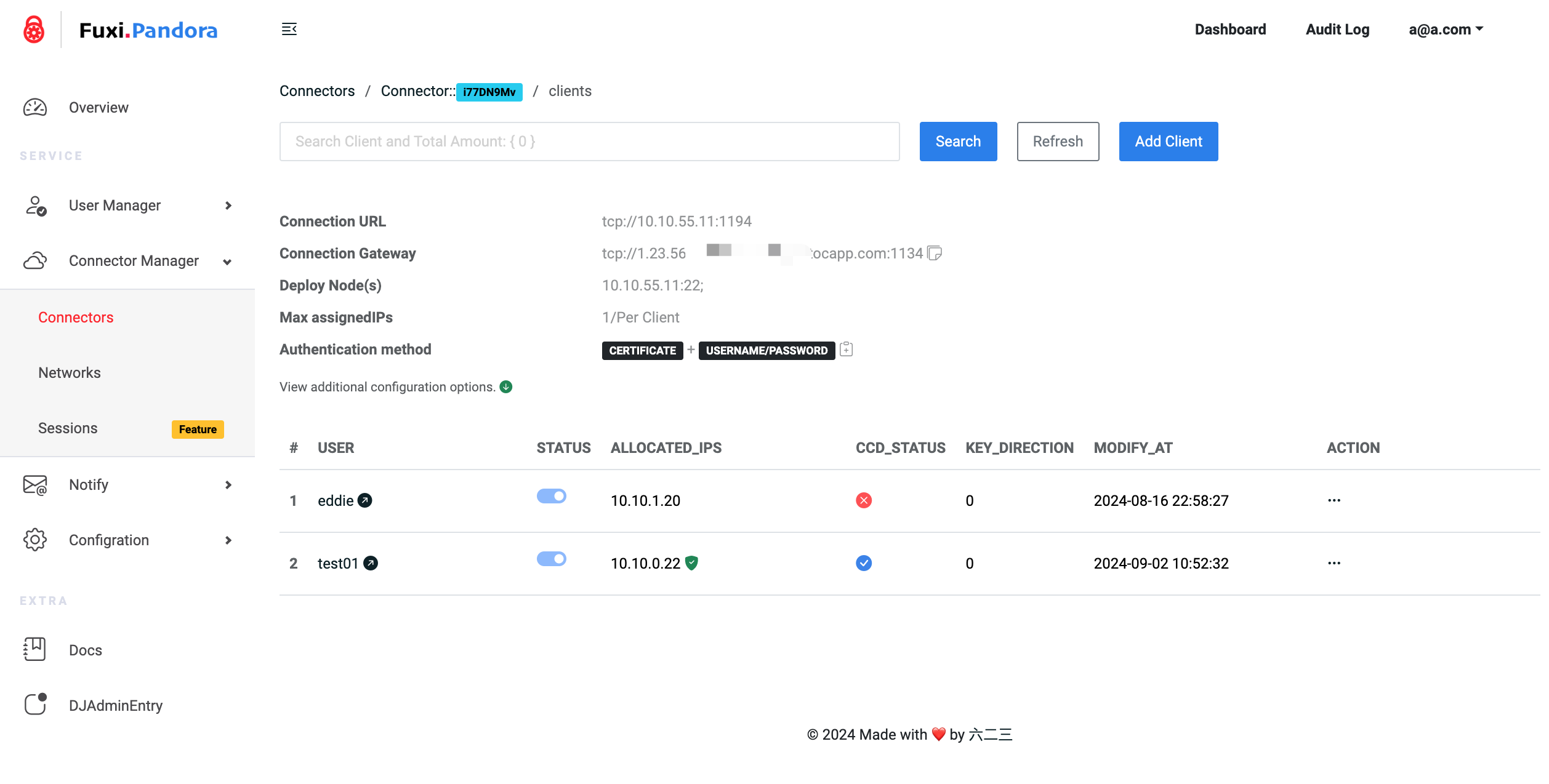

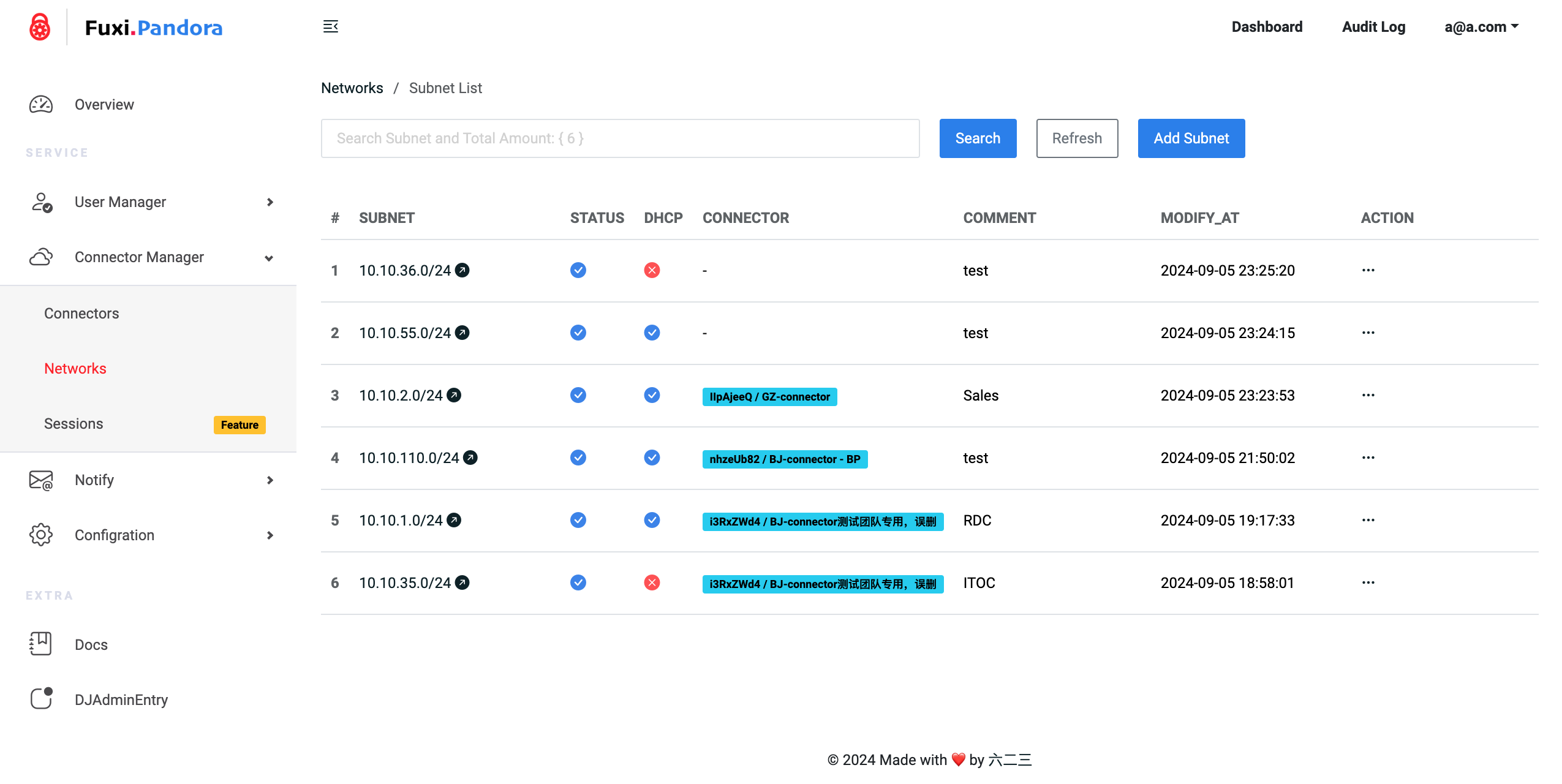

1.支持给客户端按照不同功能性部门划分网段,方便做网络控制;

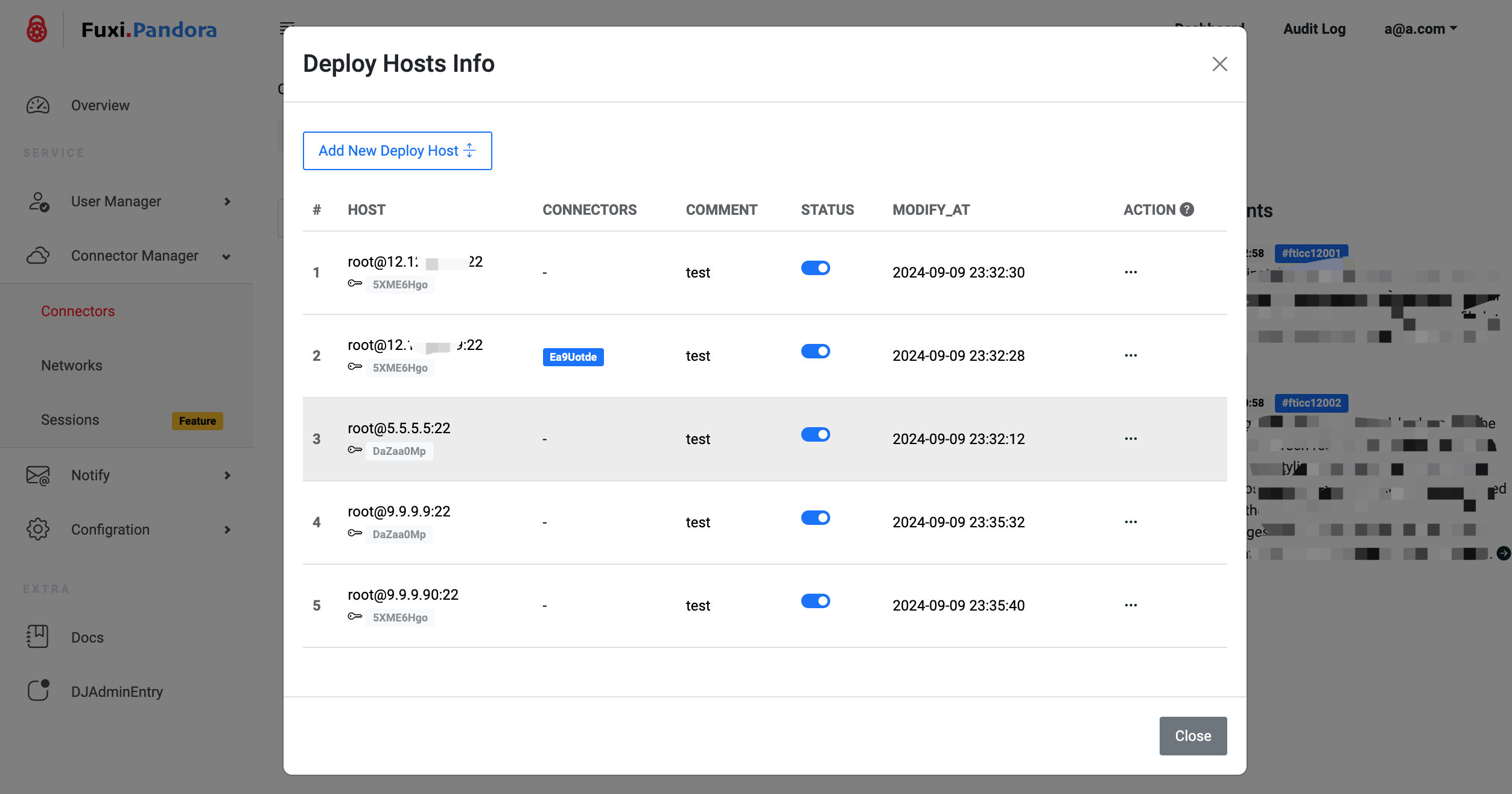

2.支持多站点的OpenVPN节点管理,如:服务节点的健康检查、路由管理等

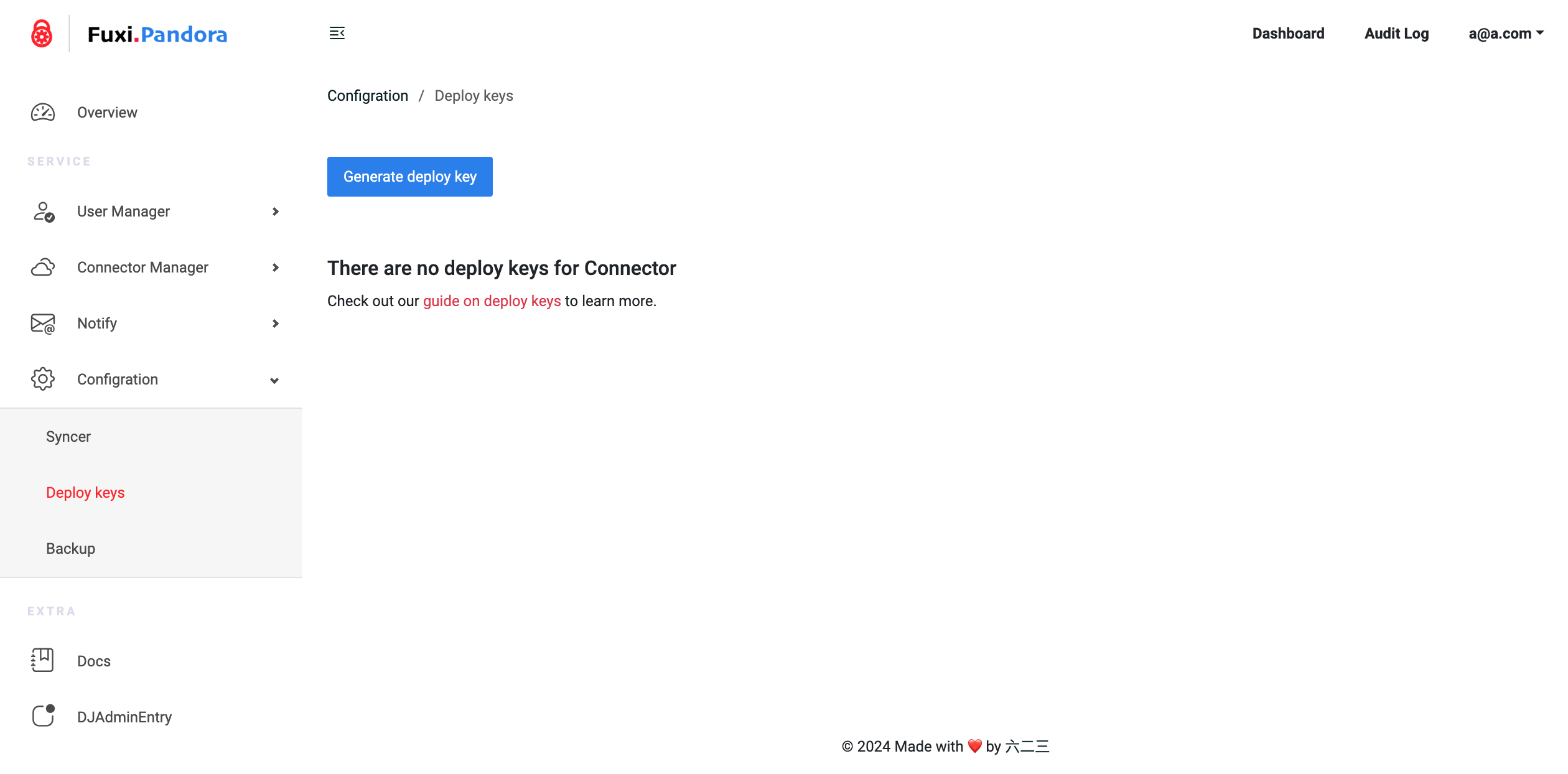

3.所有日常操作无需登陆服务设备执行命令行操作,方便交接给非技术管理员维护;

4.支持为每个客户端自定义路由;同时支持服务端部署节点的路由管理;

5.支持消息通知渠道定制化,Email,SMS,飞书,钉钉,企业微信等;

6.支持OA系统(RestAPI, OpenLDAP等)用户源数据定期自动同步;支持集成统一单点登录;

7.可提供基于Prometheus监控体系的信息采集;

8.支持计划内的敏感数据备份;

9.支持如下几种客户端限制方式:1)客户端登陆IP; 2)客户端操作系统,如Linux/Windows/MacOS/Android/FreeBSD等; 3)客户端mac地址; 4)计划时间段;

10.支持指定客户端CN即时踢下线;

11.支持客户端流量统计;

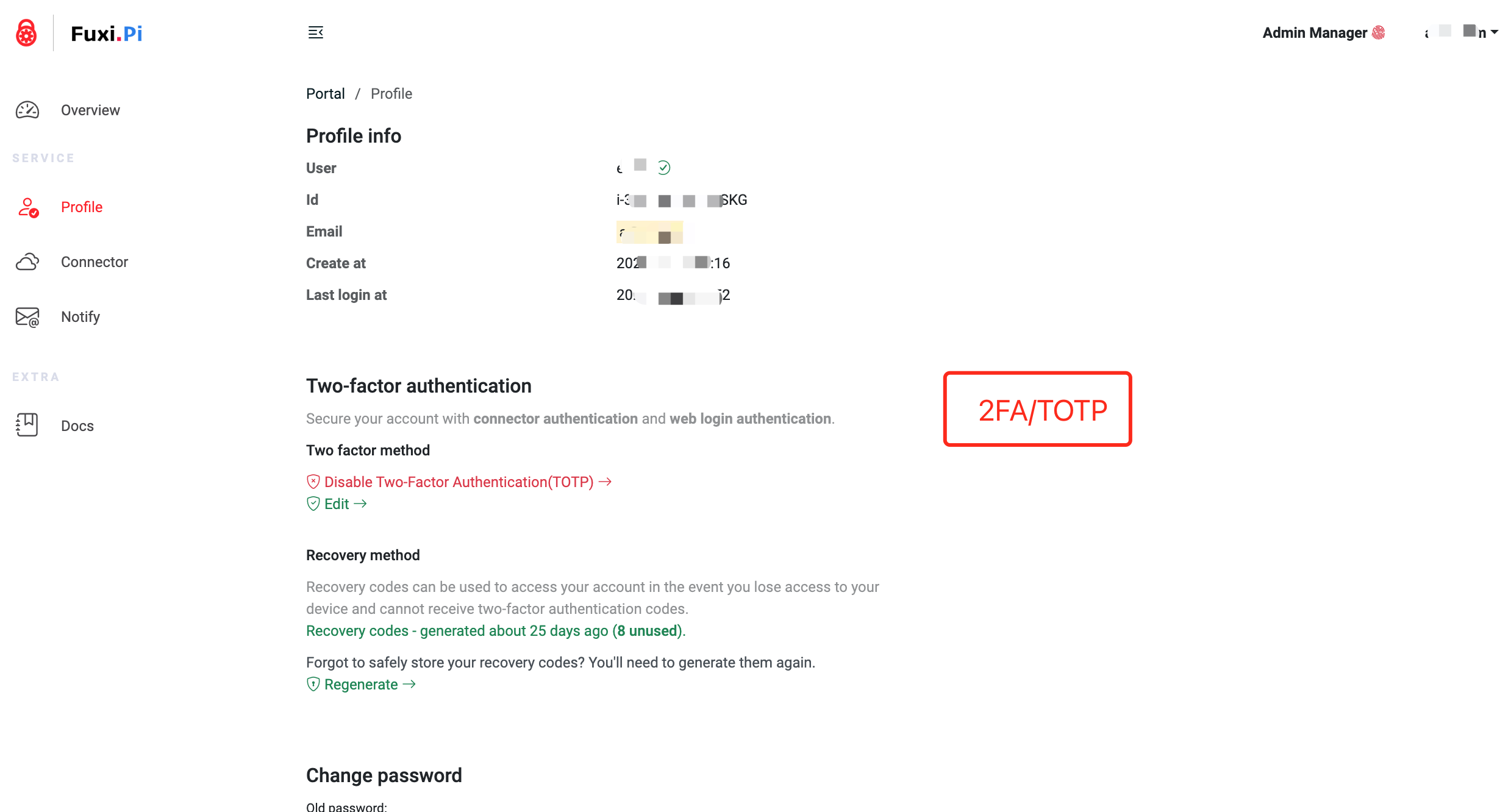

12.支持客户端启用2FA/TOTP认证,控制台实时开启即可生效;

13.可定制化提供API查询接口

14.实验性支持基于客户端IP/CN的高性能QOS;

15.实验性支持UDP over FakeTCP的伪装 合规问题,请勿再咨询!